Samoorganizacja:

Samoorganizacja:

uczenie bez nadzoru uczenie bez nadzoru

Wykład 5

Włodzisław Duch

Uniwersytet Mikołaja Kopernika

Google: W. Duch

Co będzie Co będzie

• Mapy w mózgu

• Samoorganizacja

• Sieci SOM (sieci Kohonena)

Mapy senso-motoryczne

Mapy senso-motoryczne

Mapy senso-motoryczne

Mapy senso-motoryczne

Samoorganizacja Samoorganizacja Samoorganizacja Samoorganizacja

Uczenie bez nadzoru: wykrywanie cech w sygnale, modelowanie

danych, analiza skupień, modele rozkładu prawd. stanów środowiska ...

Powstawanie wewnętrznych reprezentacji w mózgu: skomplikowane.

Proste bodźce wyzwalające u zwierząt, uboga reprezentacja.

Analiza danych zmysłowych i instrukcje motoryczne - neurony o podobnych funkcjach są obok siebie => mapy topograficzne.

• Mapy somatosensoryczne układu czuciowego, Mapy somatosensoryczne układu czuciowego,

• mapy motoryczne kory i móżdżku, mapy motoryczne kory i móżdżku,

• mapy tonotopiczne układu słuchowego, mapy tonotopiczne układu słuchowego,

• mapy orientacji dwuocznej układu wzrokowego, mapy orientacji dwuocznej układu wzrokowego,

• mapy wielomodalne układu orientacji (wzgórki czworacze górne) mapy wielomodalne układu orientacji (wzgórki czworacze górne)

Mapy czuciowe i motoryczne

Mapy czuciowe i motoryczne

Mapy czuciowe i motoryczne

Mapy czuciowe i motoryczne

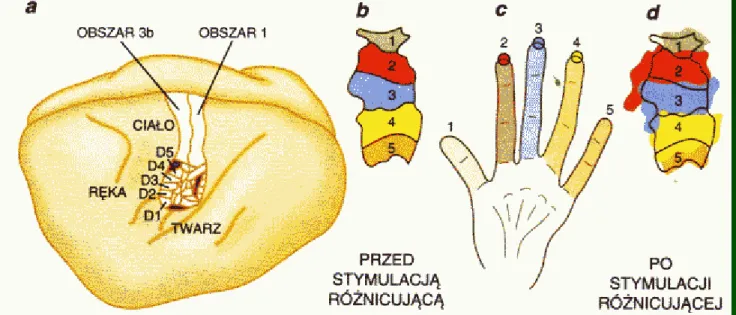

Mapa palców

Mapa palców

Mapa palców

Mapa palców

Modele samoorganizacji Modele samoorganizacji

SOM lub SOFM (Self-Organized Feature Mapping) - samorganizująca się mapa cech.

Jak mapy topograficzne mogą się utworzyć spontanicznie?

Połączenia lokalne: neuron silnie pobudzany przez pobliskie, słabo przez odległe, hamowany przez neurony pośrednie.

Historia:

•

von der Malsburg i Willshaw (1976), uczenie konkurencyjne, mechanizm Hebbowski,aktywacja typu „Meksykańskiego kapelusza”, początkowo model układu wzrokowego.

•

Amari (1980) - model ciągłej tkanki neuronowej.•

Kohonen (1981) – najbardziej popularne uproszczenie: sieci bez hamowania, tylko dwie fazy - konkurencja i kooperacja.Stąd często sieć SOM nazywa się też „siecią Kohonena”.

Uczenie SOM Uczenie SOM

Neurony reagują na sygnały X podobne do W.

Podobny = iloczyn skalarny największy lub odległość min.

Znajdź najsilniej reagujący neuron c.

2; arg min

j i ij j j

i

X W c

X W X W

Przesuń wagi neuronu c i innych neuronów w sąsiedztwie O(c):

1 ,

, dla

i

t

it h r r t

i c t

it i O c

W W X W

2 2

( , , )

c 0( )exp

c/

c( ) h r r t h t r r t

w stronę wektora X:

Algorytm SOM Algorytm SOM Algorytm SOM Algorytm SOM

Wektory danych X={X

1, X2 .. XN}.Siatka neuronów i = 1 .. K w 1D-3D,

każdy neuron wektor z N wagami W

i(t) = {Wi1 Wi2 .. WiN}, t - dyskretny czas; nie ma połączeń pomiędzy neuronami!1.

Inicjalizacja: przypadkowe Wi(0) dla wszystkich i=1..K.Funkcja sąsiedztwa h(|r-rc|/(t),t) definiuje wokół neuronu położonego w miejscu rc siatki obszar Os(rc).

2.

Oblicz odległości d(X,W), znajdź neuron z wagami Wc najbardziej podobnymi do X (neuron-zwycięzcę).3.

Zmień wagi wszystkich neuronów w sąsiedztwie Os(rc)4.

Powoli zmniejszaj siłę h0(t) i promień (t).5.

Iteruj aż ustaną zmiany.Efekt: podział (tesselacja) na wieloboki Voronoia.

2D => 2D, kwadrat 2D => 2D, kwadrat 2D => 2D, kwadrat 2D => 2D, kwadrat

Rozkład jednostajny w kwadracie. SOM uczy się jednorodnego rozkładu. Początkowo wszystkie W0.

Sieć 2D, dane 3D Sieć 2D, dane 3D Sieć 2D, dane 3D Sieć 2D, dane 3D

x y z

oo o

o 'oo o'

o

o o=dane

2-D siatka

wagi przypisane neurony wejściowe

przestrzeń cech

połączeniom

neuronów ' = wagi sieci

' ' ' ' ' ' ' '

'' ''

' '' ' '

' '

' '

' '

Uczenie sieci 2D Uczenie sieci 2D Uczenie sieci 2D Uczenie sieci 2D

o

o ox o

x

x x=dane

siatka neuronów

N-wymiarowa

o=pozycje wag x

neuronów o

o o

o o o

o

o

przestrzeń danych

wagi wskazują na punkty w N-D

w 2-D

Sieć 1D, dane 2D

Sieć 1D, dane 2D

Sieć 1D, dane 2D

Sieć 1D, dane 2D

2D => 1D trójkąty 2D => 1D trójkąty 2D => 1D trójkąty 2D => 1D trójkąty

Tworzenie się fraktalnych krzywych Peano.

Zniekształcenia Zniekształcenia

Początkowe zniekształcenia mogą zniknąć lub pozostać.

Stała uczenia Stała uczenia

Duża stała uczenia

prowadzi do eksploracji znacznej części

przestrzeni.

Symulacje z równomiernym

rozkładem wektorów;

końcowy podział jest równomierny.

Modyfikacje SOM Modyfikacje SOM

SOM działa jak metoda klasteryzacji k-średnich jeśli funkcja sąsiedztwa staje się deltą, czyli = 0.

; , 1 2 ,

2i i j j

j

t h r r t t t

X W X W

Neuron-zwycięzca ma najmniejszy błąd lokalny:

2arg min

i j,

ji j